입력 : 2023-11-14 16:48:36

- 내년 2분기 출시 예상...조만간 나오는 AMD의 MI300X와 경쟁

엔비디아가 인공지능 연산속도를 2배 가량 키운 차세대 인공지능 반도체 H200을 공개했다.

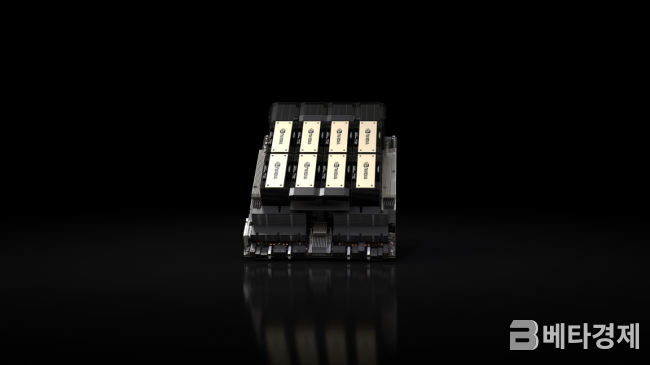

< 엔비디아의 최신 AI 칩 'H200' /=엔비디아 제공. >

엔비디아는 13일(현지시간) 생성형 AI 모델의 기반이 되는 대규모 언어 모델(LLM)에 적용해 이를 훈련하도록 설계된 그래픽처리장치(GPU) H200을 공개했다.

H200은 챗GPT 개발사 오픈AI의 최신 LLM인 GPT-4 훈련에 적용되는 등 전 세계 기업들이 확보하기 위해 경쟁을 벌이는 H100의 업그레이드 버전이다.

H200에는 141기가바이트(GB)의 차세대 메모리 'HBM3'가 탑재됐다.

고대역폭 메모리를 뜻하는 HBM(High Bandwidth Memory)은 여러 개의 D램을 수직으로 연결해 데이터 처리 속도를 혁신적으로 끌어올린 고성능 제품이다. &이로 인해 AI 모델을 사용한 텍스트, 이미지 등의 생성 능력과 추론 능력이 향상됐다.

HBM3은 HBM의 4세대 제품으로 칩이 텍스트와 이미지 등을 생성하기 위해 훈련된 LLM이 추론하는 데에도 도움을 준다.

엔비디아는 H200을 메타의 LLM인 라마2에 사용한 테스트를 근거로 H100보다 2배 빠른 출력을 낸다고 설명했다. 또 H200은 H100과 호환된다며 H100을 확보한 AI 기업들이 새로운 버전을 사용하기 위해 서버 시스템이나 소프트웨어를 바꿀 필요가 없다.

아울러 이 칩은 H200 GPU와 암(Arm) 기반 프로세서를 결합한 'GH200'이라는 칩과 엔비디아의 컴퓨팅 플랫폼인 HGX의 서버 구성에 사용될 수 있다.

H200은 오는 2024년 2분기에 본격 출시될 예정으로 미국 반도체 기업 AMD가 지난 6월 출시한 최첨단 인공지능 GPU인 'MI300X'와 AI용 반도체 시장에서 경쟁할 것으로 보인다. MI300X 반도체는 엔비디아 H100 대비 메모리 밀도가 2.4배, 대역폭이 1.6배 수준이다.